Apple cho biết tính năng quét iCloud của họ sẽ dựa vào nhiều nhóm an toàn cho trẻ em để giải quyết nỗi lo về quyền riêng tư

Apple đã điền thêm thông tin chi tiết về kế hoạch sắp tới của mình để quét iCloud Photos để tìm tài liệu lạm dụng tình dục trẻ em (CSAM) qua iPhone và iPad của người dùng.

Ảnh minh họa bởi: Alex Castro / The Verge

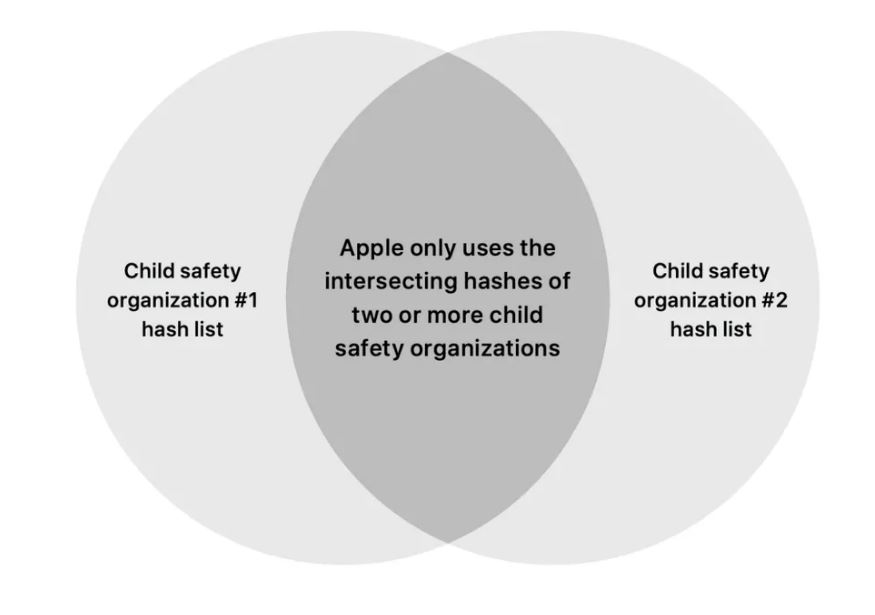

Apple đã phát hành một bài báo mới nghiên cứu về các biện pháp bảo vệ mà họ hy vọng sẽ làm tăng sự tin tưởng của người dùng vào sáng kiến này. Điều đó bao gồm quy tắc chỉ gắn cờ các hình ảnh được tìm thấy trong nhiều cơ sở dữ liệu an toàn trẻ em với các cơ quan chính phủ khác nhau - về mặt lý thuyết ngăn một quốc gia thêm nội dung không phải CSAM vào hệ thống.

Các bản phát hành iOS và iPadOS sắp tới của Apple sẽ tự động khớp các tài khoản Ảnh iCloud có trụ sở tại Hoa Kỳ với CSAM đã biết từ danh sách các hàm băm hình ảnh do các nhóm an toàn trẻ em tổng hợp. Trong khi nhiều công ty quét các dịch vụ lưu trữ đám mây từ xa, Tuy nhiên, chiến lược dựa trên thiết bị của Apple cũng đã bị một số chuyên gia về quyền riêng tư và bảo mật chỉ trích gay gắt.

Bài báo có tên “Đánh giá mô hình về mối đe dọa bảo mật về các tính năng an toàn cho trẻ em của Apple”, hy vọng sẽ xoa dịu những lo ngại về quyền riêng tư và bảo mật xung quanh việc triển khai đó. Nó được xây dựng dựa trên một cuộc phỏng vấn của Wall Street Journal với Craig Federighi, giám đốc điều hành của Apple, người đã phác thảo một số thông tin vào sáng nay.

Trong tài liệu, Apple cho biết họ sẽ không dựa vào một cơ sở dữ liệu duy nhất do chính phủ liên kết - như cơ sở dữ liệu của Trung tâm quốc gia về trẻ em mất tích và bị bóc lột có trụ sở tại Hoa Kỳ, hoặc NCMEC - để xác định CSAM. Thay vào đó, nó sẽ chỉ khớp các hình ảnh từ ít nhất hai nhóm có các quốc gia liên kết khác nhau. Mục tiêu là không một chính phủ nào có thể bí mật chèn nội dung không liên quan cho mục đích kiểm duyệt, vì nó sẽ không khớp với các hàm băm trong bất kỳ cơ sở dữ liệu nào khác.

Ảnh: Apple

Apple đã đề cập đến khả năng sử dụng nhiều cơ sở dữ liệu an toàn cho trẻ em, nhưng cho đến hôm nay, hãng vẫn chưa giải thích về hệ thống chồng chéo. Trong một cuộc gọi với các phóng viên, Apple cho biết họ chỉ đặt tên cho NCMEC vì nó vẫn chưa hoàn tất các thỏa thuận với các nhóm khác.

Nó cũng cung cấp thêm thông tin về hệ thống kiểm soát mà Federighi đã đề cập. Danh sách các hàm băm CSAM đã biết của Apple sẽ được đưa vào iOS và iPadOS trên toàn thế giới, mặc dù hiện tại hệ thống quét sẽ chỉ chạy ở Hoa Kỳ. Apple sẽ cung cấp danh sách đầy đủ các hàm băm mà kiểm soát viên có thể kiểm tra dựa trên cơ sở dữ liệu an toàn cho trẻ em.

Federighi thừa nhận rằng Apple đã đưa ra "sự nhầm lẫn" với thông báo của mình vào tuần trước. Nhưng Apple đã tự mình cập nhật - hãng nói với các phóng viên rằng mặc dù vẫn đang hoàn thiện và lặp lại các chi tiết, nhưng hãng đã không thay đổi kế hoạch ra mắt để đáp lại những lời chỉ trích của tuần trước.

Tham khảo - Theverge